新兴诈骗三件套,批量涌入直播间

来源:倍可亲(backchina.com)人不能两次踏进同一条河流,但却可以同时出现在三场直播间。

这是演员温峥嵘的亲身遭遇。

不久前,网友们发现了一件怪事:温峥嵘仿佛有了分身术,同时在好几个直播间里露面,讲解着不同的产品。

镜头里的她,妆发服装不同,但长相和声音却一模一样。

起初,大家以为这不过是常见的录播或假直播套路,但仔细一看才发现事情比想象的更严重。

屏幕里滔滔不绝的身影,根本不是温峥嵘本人。

甚至都不是一个真人,而是用AI制造的数字主播。

不法商家盗用了她的容貌和声音,批量制造分身带货。其逼真程度,足以让普通人难辨真假。

在许多人的印象里,AI的以假乱真还停留在仅供娱乐的粗糙阶段,但技术早已在暗中迭代到令人毛骨悚然的地步。

以前,一个人要费力证明“我是我”;

而现在,则要拼命辩解“为何我不是我”。

科技带给了我们便利,也让事情朝着更复杂的方向发展。

如果一个人的脸和声音可以被随意盗用,那么任何人都可能成为一个被随意操控的工具。

在这场洪流中,我们每个人都无法置身事外。

顶流明星,正被AI批量「盗脸」

温峥嵘对这段遭遇的讲述,极具魔幻色彩——

拍完戏回到家后,她照常刷着手机,却突然看到“自己”正在直播,于是下意识留言质问:

“你是温峥嵘那我是谁?”

荒诞的是,评论刚发出去,她就被“温峥嵘”拉黑了。

黑色幽默般的故事,甚至衍生了一个热搜词条:#温峥嵘被AI温峥嵘拉黑#。

事实上,这场换脸闹剧已经持续了很长时间。

早在今年4月,温峥嵘就曾公开打假,称许多山寨号不断更换名字和ID来冒充她,提醒粉丝们谨慎。温峥嵘团队公开表示已向不法商家发送律师函,可侵权行为屡禁不止。

粉丝无奈发帖称:一天举报18个假账号,根本举报不过来。

实际上不止温峥嵘,好多名人都遭遇过AI换脸。

在假温峥嵘的直播中,AI生成的“刘涛”“张柏芝”都来站台,一起捧场寒暄。

演员刘晓庆在综艺里吃鱼的镜头,被嫁接成了减肥产品广告,还被安排了各种鸡汤演讲。

逼得刘晓庆本人不得不公开质问:“画面是我、声音很像我,但不是我,这是怎么做到的?”

央视主持人李梓萌,被伪装在直播间推销鱼油,背景板还贴上了“央视推荐”。

甚至连德高望重的张伯礼院士,也被AI安排去一众综艺明星面前为“国货”站台。

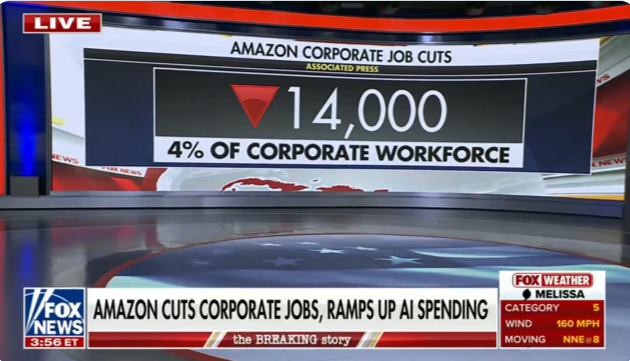

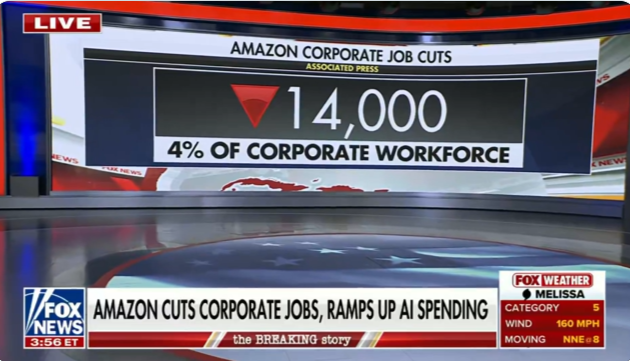

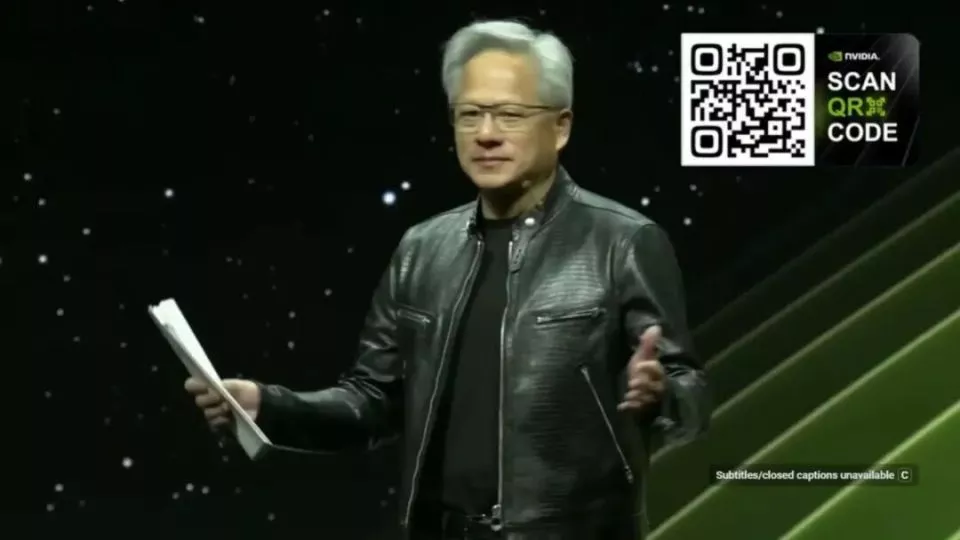

10月的英伟达GPU技术大会上,黄仁勋登台没几分钟,一个假黄仁勋就同步开启了直播,宣传加密货币。

结果,吸引到的观众比真黄仁勋还多。

在AI明星批量直播的同时,幕后操纵者还展现出了惊人的产品思维:

古天乐就该代言游戏,杨幂天生适合带货衣服,张馨予则要去代言减肥药......

于是你能看到野生的“杨幂”出没在服装直播间,山寨的“古天乐”在游戏广告里砍着传奇。

〓直播卖衣服的假杨幂

骗子们主打一个谁火就换谁的脸。

前段时间,某平台随处可见“全红婵”卖土蜂蜜:“500单土蜂蜜16块9发两斤,叔叔阿姨可以下单。”

光是“全红婵”一个人还不够,全家齐上阵,叔叔妈妈爸爸都来卖蜂蜜。

有的号还会精心编造剧本,声称“婵宝想让家里的生活更好一点,今天拿出老家300单土鸡蛋送福利。”

爆火的“莎头”组合也来助兴,要给大家发婵妹的土鸡蛋。

从明星、主持人再到奥运冠军,AI换脸几乎把所有能变现的流量都算计到了。

除此之外,换脸不止用来带货,造谣更是信手拈来。

薛凯琪被编造恋情,霉霉被生成虚假色情图片,雷军在互联网上骂人……最后都逼得当事人不得不出来辟谣。

随着AI换脸侵权波及的范围越来越大,互联网呼吁监管的声浪也越来越高。

被“假靳东”冒充行骗的靳东,在两会上提交了AI技术与网络平台立法的建议。

霉霉事件引起了美国白宫的关注,表态国会应该采取立法行动来监管AI。

然而,道高一尺、魔高一丈。

明星们忙着和AI制造的自己割席的同时,AI盗脸的魔爪早已伸向普通人。

Ai换脸的第一批受害者

维权失败

活在聚光灯下的名人尚有团队庇护,可以发声辟谣。而当AI换脸的恶意对准普通人,后果则更加不堪。

其中最恶劣的莫过于青岛保时捷销冠被造黄谣事件。

牟女士作为一年卖出170辆保时捷的销冠,因业务能力突出被媒体采访。

节目播出后,网络上突然流传出牟女士的虚假不雅视频。牟女士的社交媒体随即被大量的私信骚扰淹没:“看视频来的,找你买车有服务吗?”

数字时代,每个人随手发出的照片都可能被有心人保存起来,用于其他目的。

据《每日经济新闻》报道,小雅的朋友在朋友圈刷到了一个复刻版的小雅,相似度高达100%,就“头发丝都一模一样”。

小雅和朋友反复对比,发现有人盗用了小雅公开发布的照片,用AI生图技术“克隆”了她。虽然没有造成恶劣影响,但也足以让小雅胆战心惊:

“谁知道对方拿着照片做了什么呢?”

当技术被用来作恶,人性的幽暗便有了最锋利的武器。

看别人挣钱太多?那就把她移花接木到不雅视频。

制作裸照能赚钱?那就批量伪造裸照到境外平台售卖。

没能和暗恋女生在一起?那就AI换脸进行报复......

只要一个人暴露了自己的长相,就有可能被AI换脸。

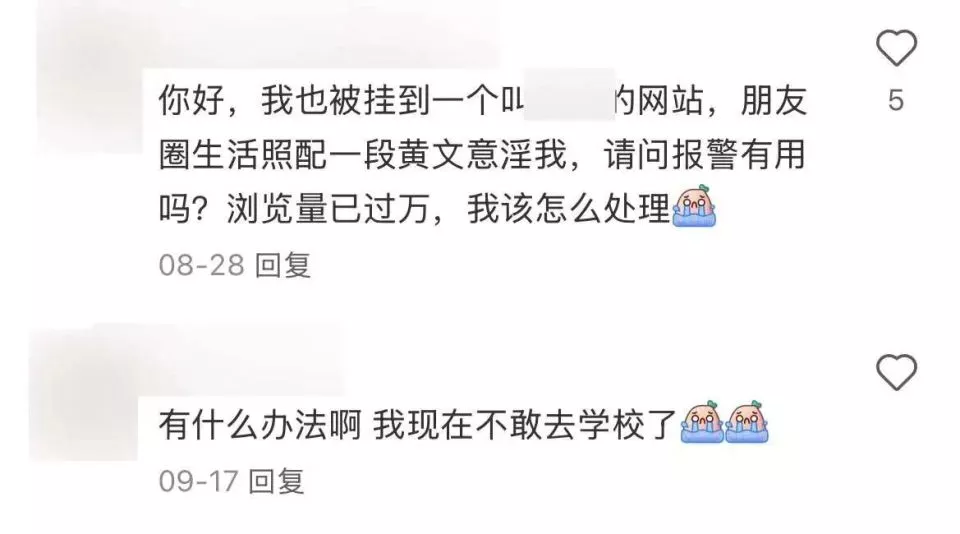

去年,韩国Deepfake事件震惊全球——犯罪者通过付费群组上传女性照片伪造色情内容,进而广泛传播。

受害者涵盖未成年人、教师、军人、明星等各个年龄和职业的人群,甚至还有以女性家人为目标的“家庭群组”“近亲群组”。

也就是说,许多女性根本不知道自己什么时候就被盯上,而制作AI换脸的人可能是身边的朋友、同学,也有可能是完全不认识的陌生人。

这种威胁的恐怖之处就在于它的无孔不入与随机性。

当恶意从熟悉或陌生的角落袭来,受害者甚至来不及辩解,就已坠入深渊。

被AI换脸的网友表示不敢再前往人群,日常生活遭受严重干扰。

Deepfake受害者的心理创伤植入日常,只要收到短信通知或匿名电话的铃声,就会心跳加速,陷入恐惧。

除了肖像权侵害、名誉损害,AI换脸还被广泛用于诈骗。

与早期粗劣的诈骗方式不同,骗子们如今早就准备好了高度定制化专属剧本。

一位母亲会收到“女儿”的多条语音,催着缴纳报名费,焦急之下立即向骗子账户转账3.5万元;

经常联系的“朋友”会给你打来视频哭着借钱,几秒钟就骗走几十万......

以前我们总认为,只有老年人才容易被骗,但当技术逼真到足以乱真,每个人都可能成为下一个猎物。

焦虑的年轻人寻求精神慰藉,骗子就利用AI换脸技术伪造“通灵视频”,以此骗取信任和钱财。

打工人需要时常开会,骗子就伪装成总部高管召开跨国视频会议,一通指令当场就能骗走2亿港元。

在AI面前,眼见为实的古老经验正在失效。我们必须要接受:

眼见不再为实,耳听也可能为虚。

而这一切之所以变得如此猖狂 ,根源在于作恶的门槛,已经低到令人发指。

AI换脸属于深度伪造技术(Deepfake)。利用深度学习算法,“喂”给AI目标人物的图像和视频数据,机器就能学会捕捉并模仿一个人的面部特征——小到说话时的口型变化、细微的肌肉牵动,大到眼神和神态,都能模拟得惟妙惟肖。

随后,AI再将这些动态特征嫁接或替换到另一个人的视频上,喜怒哀乐、一颦一笑都无比自然。

前面提到的假黄仁勋直播,就成功欺骗了数千人,连美国电台CNBC都没有辨认出来。

在技术的早期阶段,制作逼真的伪造视频还需要高深的专业知识和计算资源。然而,随着技术的狂飙突进,大量看似用户友好、甚至傻瓜式的应用程序和平台涌现,使得深度伪造技术彻底平民化、普及化。

正如一名不法分子所说:“只要能看到脸的,都能换。”

巨大的便利让深度伪造技术在法律和伦理的真空地带野蛮生长。那么也不禁让人想问:

面对猖獗的AI换脸,法律为何一再失效?

AI换脸「黑产」曝光:

463元就能定制一个你

坦白说,在全球范围内,AI换脸都是一个棘手的难题。

主要原因在于技术发展与法律滞后。

技术与监管之间的关系,就像一场永无休止的猫鼠游戏:

一旦检测技术攻破了当前的伪造技术,后者就会迅速进化,使检测技术永远处于滞后状态。

想要追溯源头和找证据也没那么简单。

数字世界里,一条视频的生成和扩散速度快到惊人 ,而且每一次转发、每一次分享,都在不断模糊最初的作恶痕迹,让追踪变得无从下手。

另一个难以回避的困境是:法律的制定总需要严谨的流程和漫长的时间,这与AI技术的瞬息万变形成了鲜明对比。

韩国Deepfake调查人员需要获得法院批准,才能用秘密身份进入深度伪造聊天室。

当监管人员终于发现线索,并费尽周折等到法院批准后,这个聊天室往往已经消失在了互联网的汪洋大海之中。

跑得太快、藏得太深、程序太慢,是AI换脸难以遏制的三大症结。

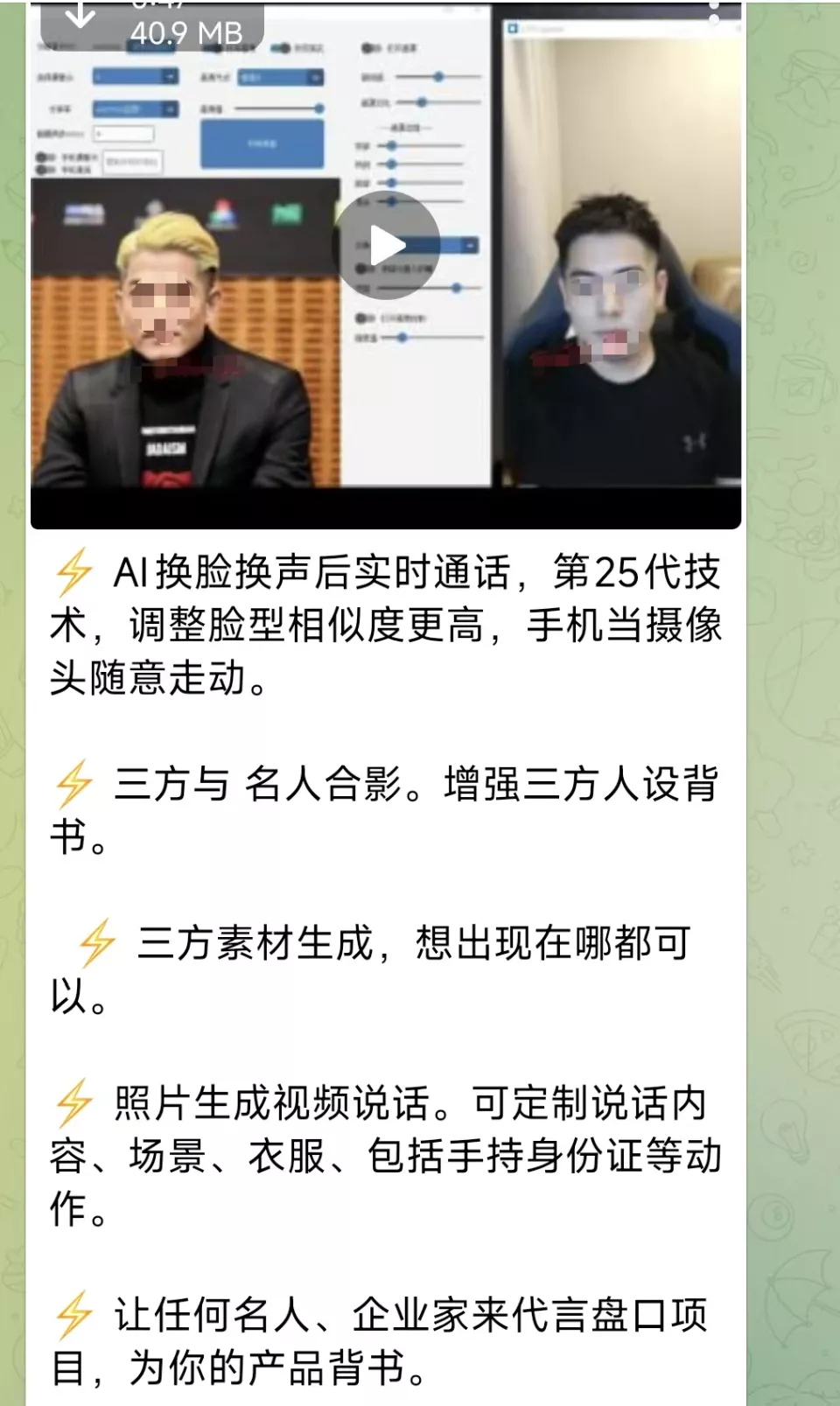

另一方面,AI换脸无法杜绝,也与它背后已经形成的完整产业链息息相关。

服务会根据客户需求难度进行明码标价:换脸换声人民币(专题)463元,只换声音约为228元,并且都可以定制话术。

有的AI换脸工具会伪装成普通绘图软件,然后在产品详情页中明标注“可实现换头换衣功能”,心照不宣地吸引受众下单。

还有人专门组合兜售诈骗软件和教程,大言不惭地宣称用这套工具做出来的伪造内容,“找不到丝毫破绽” 。

〓黑灰产卖家宣传信息,来源:新京报

当技术、金钱和人性中的恶叠加,这种对抗注定是一场漫长的拉锯战。

最无力的就是受害者,他们维权的难度,远超想象。

很多时候,受害者必须自己承担起侦探的角色。Deepfake受害者们为了追查源头和主犯信息,整整花费了两年时间,才艰难地追踪到关键线索。

付出巨大的精力与成本,可能最终只能看到轻微的惩罚,与他们遭受的名誉和精神损失完全不成正比。

近几年,AI技术犹如脱缰的野马,以超越想象的速度飞速成长,它在带来颠覆性便利的同时,也像一个被打开的潘多拉魔盒,引发了海啸般的诸多问题。

我们站在历史的分岔路口,目睹了AI在效率和作恶之间摇摆的影子。

技术仍在狂奔,但如何为其套上伦理的缰绳、守住人性的底线,人类仍有很长的路要走。

遗憾的是,即便有一天法律跟上了技术,也无法抹平受害者遭遇的伤痛。