再现人类的偏见:能用中文聊天的机器人风靡全球

来源:倍可亲(backchina.com)新一代人工智能技术驱动的聊天机器人ChatGPT问世刚一个月就吸引了上百万的用户蜂拥试用,在全球的流行程度呈爆炸式增长。

ChatGPT是美国初创公司OpenAI去年11月底推出的一个自然语言处理工具。它由新一代人工智能技术驱动,会和向它提问的人进行类似人类之间的书面对话。

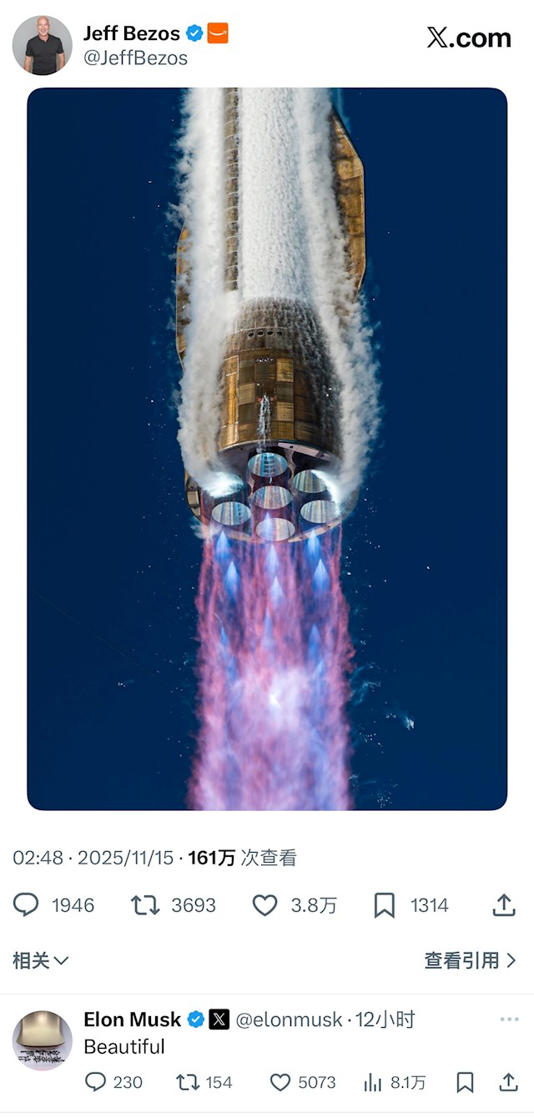

这款在线AI工具让马斯克直呼“好到令人生畏”。但ChatGPT聊天机器人究竟是什么样的?它给诸多行业以及我们的伦理和立法带来什么样的挑战?

ChatGPT是什么?

ChatGPT可供任何有互联网连接的人免费使用,并且设计得更加人性化。

ChatGPT的工作机理是从电子书籍、在线著作和其他媒体的庞大数据库中学习,并将所学的内容生成可读文本来回答你的各种问题。

它的强大功能可以在短短几秒钟的时间帮你完成原本耗时耗力的任务,如撰写电邮、文章和代码。

由于ChatGPT正处于研究和收集反馈的阶段,因此目前向公众免费开放使用。而大众的使用也会使这款聊天机器人变得更加聪明。

自其面世以来,ChatGPT对浩瀚知识海洋中各领域问题的翔实且清晰的回答震惊四座,惊艳各界研究者和专业人士。

但是,它对于事实准确性的把握时好时差,因此也被认为是该平台目前的一个重要缺点。

谁在用ChatGPT做什么?

过去一个月来,全球已有数以百万计的用户体验过ChatGPT,让它写英文诗歌、日本俳句、流行歌曲或脱口秀,有的用户提问ChatGPT各种有关人工智能和人类智慧的问题,有的用户试图诱使它犯错,也有人用它来完成更实际的任务,如帮助自己写代码编程、撰写电子邮件或给某位家庭成员设计一份有创意的假日礼物。

许多中文用户也向ChatGPT提出了形形色色的考题:用李白的文风写程序注释,用鲁迅体表达疫情下不敢出门的心情以及做数学题,而ChatGPT的回答往往赢得一片赞叹。

在专业领域,网络作家用它来写小说、剧本和少儿图书。

ChatGPT可以使用英文之外的多种语言和用户交流,包括中文、阿拉伯文、挪威文、西班牙文、法文等,但据《耶路撒冷邮报》报道ChatGPT用希伯来文有点困难。

目前微软公司计划使用ChatGPT的人工智能来加强其必应(Bing)搜索引擎,且正在考虑添加ChatGPT技术进入其广为使用的Word、PowerPoint和Outlook等软件。

据《商业内幕》报道,微软曾投资OpenAI公司十亿美元,最新消息称微软正与ChatGPT的拥有者OpenAI磋商追加100亿美元投资。

学生能否用它来写作业?

简而言之,不能。

ChatGPT能够对各种主题的提示做出完美的文章回应,这种令人生畏的强大文本功能的确对教育界提出了迫在眉睫的挑战。

一些学校和教育工作者担忧,这样的人工智能产品不仅会令学校的写作作业可能很快过时,而且可能助长作弊和剽窃行为。

美国一些教育部门已经开始阻止ChatGPT成为学生们的写作工具,不让这款人工智能产品对学生的学习产生负面影响。

美国最大的学区纽约市的教育局日前颁布禁令,禁止学生们在学校设备和校内网络上使用ChatGPT,但没有阻止学生通过私人手机或家里的电脑使用ChatGPT。

此举可能会对其他学校产生连锁反应。

澳大利亚高校也迅速反应,通过改变考试及评估方式来限制学生对人工智能的使用。

据《卫报》报道,八大名校联盟为应对这项新兴技术的出现而修改了2023年对学生的考评方式,包括增加考场监督以及更多使用纸笔考试等。

澳大利亚著名的八大名校联盟(Group of Eight, Go8)包括悉尼大学、新南威尔士大学、墨尔本大学、蒙纳什大学、阿德莱德大学、昆士兰大学、西澳大学和澳大利亚国立大学。

报道说,悉尼大学最新的学术诚信政策特别提到“使用人工智能生成内容”为作弊形式。澳大利亚国立大学也改变了评估设计,以实验室活动和实地工作为评估依据,并将为考试限时且引入更多的口头报告。

此外,普林斯顿大学计算机专业大四学生爱德华·田(Edward Tian)上周发推文表示自己研发了一款能识别文本是否是ChatGPT所写的客户端GPTZero。

美国哥伦比亚广播公司CBS报道说,已有超过两万名用户演示了GPTZero的测试版,许多教师向爱德华·田致谢。

类似的工具将颠覆哪些行业?

墨尔本大学人工智能和数字伦理中心讲师沙南·柯尼博士(Shaanan Cohney)告诉ABC中文,创意行业的工作首当其冲。

柯尼博士是ChatGPT的全球用户之一。他表示,虽然ChatGPT和其他内容生成工具“令人印象深刻”,但是这些工具所生成的大部分内容可以归类为哲学家哈里·法兰克福(Harry Frankfurt)所定义的“废话”。

“就是具有令人印象深刻的影响的短语,但与事实毫无关联,”柯尼博士说,“它需要人类努力去弄清楚这些是否正确。”

一些艺术家抗议科技公司未经允许就使用他们的作品训练人工智能技术,称不仅是对他们版权的侵犯,而且创作者未得到补偿。

柯尼博士表示,对准确性要求处于次要地位的行业,诸如营销、翻译、艺术、音乐,将在其冲击下淡出前排位置。

“这些行业将被迫在一夜之间作出适应,”柯尼博士说。

他表示,这个阵营会担心归属、版权和剽窃问题,“试图找到在人工智能生成的东西上打上数学‘水印’的方法。”

我们对人工智能还担心什么?

除了最近爆红的ChatGPT,其他各种人工智能内容生成工具近年来也如雨后春笋般涌现,在各自领域中大行其道。

比如同属OpenAI公司的Dall·E 可以把文字转换为图像,Runway和Fliki可以将文字转换成视频,Murf可以把文字转换为音频,DreamFusion可以把文字转换成三维图像等等。

墨尔本大学人工智能和数字伦理中心讲师沙南·柯尼博士认为,人工智能伦理学的最大挑战之一就是人们无法就哪些问题是最重要的达成一致。

“人工智能再现了人类的偏见,并且可以传播虚假信息,”柯尼博士说,“许多人如前谷歌工程师逖名特·盖布茹( Timint Gebru)认为这是我们这个时代最重要的问题。”

2021年2月,谷歌人工智能伦理团队负责人盖布茹因质疑谷歌将现有偏见植入大型语言模型的建造中而遭谷歌解雇。

2022年6月,谷歌人工智能团队软件工程师布雷克·莱莫因(Blake Lemoine)因在接受《华盛顿邮报》采访时称谷歌的人工智能具备像人类一样的知觉力和意识而被解雇。

莱莫因公开了自己同谷歌人工智能系统LaMDA的聊天记录以佐证自己的观点,称该人工智能的“需求”需要得到尊重。

谷歌公司在当时的一份声明中表示,该公司的评估认为莱莫因的主张没有一句,并且指称莱莫因“选择持续违反从业和数据安全方面的明确政策”。

柯尼博士表示,如何统一人工智能和人类的价值观,引导人工智能系统的行为使其符合设计者的预期目标,也令一些人士担忧。

“我们如何确保我们的这些工具为我们的利益服务,而不是违背我们的利益?”柯尼博士表示。

一些艺术家则抗议科技公司未经允许就使用他们的作品训练人工智能技术,称不仅是对他们版权的侵犯,而且创作者未得到补偿。

“最后一个阵营则担心归属、版权和剽窃问题,试图找到在人工智能生成的东西上打上数学‘水印’,”柯尼博士说。

但是,即便有伦理、价值观和版权领域的深层次担忧,人工智能的浪潮终将无法阻挡,且发展速度迅猛惊人。

“虽然现在支撑ChatGPT的算法在准确性问题上苦于应付,但研究人员已经在努力解决‘奠基’问题,即找到方法使其生成的东西更准确,”柯尼博士说。

年复一年,我们越来越接近结果令人类满意的人工智能工具。柯尼博士指出,和当前每个人的手机中广泛使用的由人工智能系统助力的修图、打字、导航客户端一样,如今令人惊艳的技术也会很快变得泯然众人矣。

“几乎在某一新技术被采用的同时,它也变得平凡无奇,看来ChatGPT可能很快就会加入这个行列。”